El 19 de enero TheGlazeProject anunció la primera versión de Nightshade. Aunque parece que la intención de sus desarroladoradores es combinar esta herramienta con Glaze, de momento funcionan por separado. En este artículo explicamos cómo utilizar Nightshade y qué conviene considerar antes de usarlo.

Artículos relacionados:

- Cara Glaze: portfolios para proteger el estilo de tus obras

- Nightshade: envenenamiento de datos contra las IA

- Cómo proteger tus imágenes de los entrenadores de IA

Recapitulando: Glaze es una herramienta defensiva para artistas que no quieren que su estilo sea «rascado» para entrenar modelos de IA. Hace que las IA malinterpreten el estilo de la imagen, y previene de este modo que puedan copiar el estilo del artista. Nightshade, en cambio, es una herramienta más agresiva. Introducir imágenes con Nightshade en una IA puede corromper el modelo y generar resultados peores, incluso inservibles. Funciona incluso cuando el número de imágenes «envenenadas» no es muy alto.

El «rascado» de imágenes y qué tiene que ver con Nightshade

«Rascar» datos es utilizar bots para copiar y transformar contenido de sitios web públicos. Existen medidas estándar para evitar esto: señales que informan a los bots de que un sitio web no debe indexarse. Sin embargo, estas señales son de cumplimiento voluntario, y hay entrenadores de IA y otros bots que las ignoran.

El objetivo de Nightshade es incentivar a los entrenadores de IA a usar imágenes de uso libre o con licencia; que «rascar» indiscriminadamente sea demasiado arriesgado.

«El objetivo de Nightshade no es romper modelos, sino aumentar el coste por entrenar usando datos sin licencia, hasta que licenciar imágenes de los creadores resulte una alternativa viable.» (Fuente)

¿Cómo funciona Nightshade?

Tanto Glaze como Nightshade alteran la imagen, pero a nivel de píxel: siguen siendo comprensibles y mantienen la calidad para un ojo humano, pero confunden a una IA.

Nightshade en concreto utiliza PyTorch para identificar lo que hay en una imagen, y a continuación altera sutilmente la imagen a nivel de píxeles para que otros programas de IA la interpreten como algo completamente diferente.

Si suficientes imágenes con Nightshade entran en el sistema, el modelo de IA puede empezar a categorizar erróneamente otras imágenes, aunque éstas no usen Nightshade.

En otras palabras: subes la foto de una vaca a Nightshade, ésta la interpreta y entiende que es una vaca. La procesa y la renderiza para que una IA no vea una vaca, sino un bolso; pero un humano seguirá viendo la vaca sin problema.

Cómo usar Nightshade

Primero, descarga la aplicación desde nightshade.cs.uchicago.edu. Comprueba que tu ordenador cumple con los requisitos del sistema:

- MacOS Silicon M1, M2 o M3.

- PC con Windows 10 u 11.

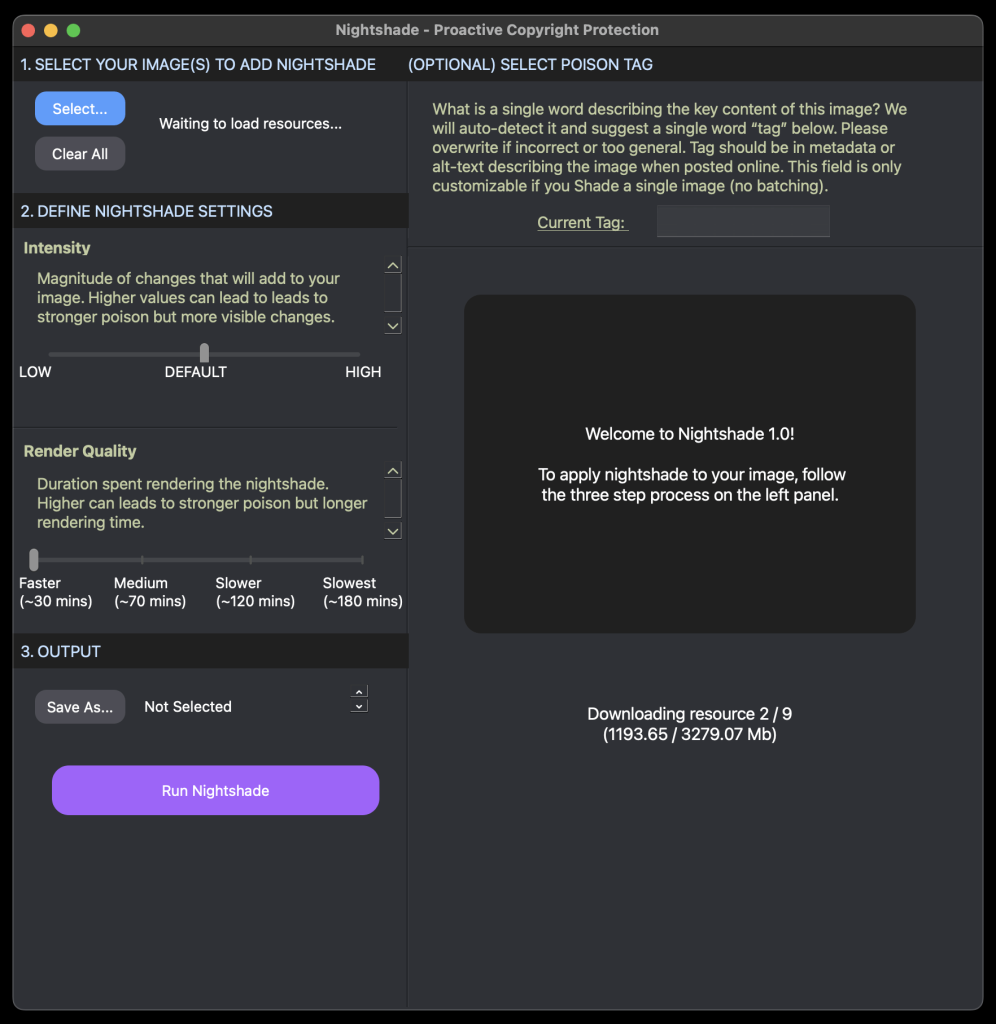

Una vez abierta la aplicación, el panel izquierdo indica las instrucciones en 3 pasos:

- Elegir la(s) imágen(es) a las que se desea añadir Nightshade y (en el apartado 3) la carpeta donde se guardarán los resultados.

- Definir la intensidad del filtro y la calidad del renderizado. El proceso es lento, requiere mucho uso de memoria, y cuanto mejor la calidad más potente es el resultado.

- Guardar el resultado.

Configuración opcional en el panel derecho: Nightshade utiliza IA para detectar el contenido de la imagen, y genera un tag descriptivo. Si es incorrecto o demasiado general, se puede corregir.

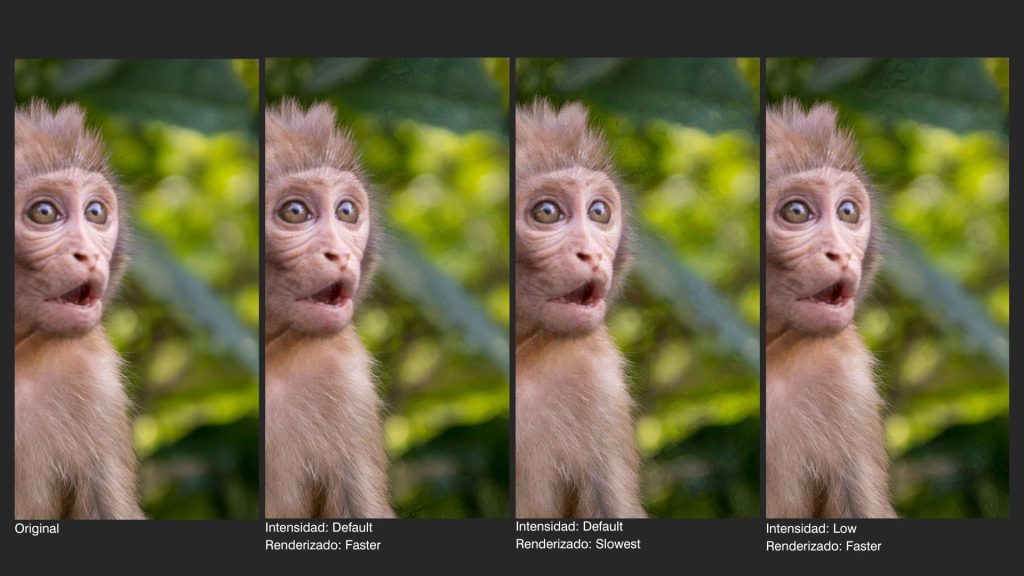

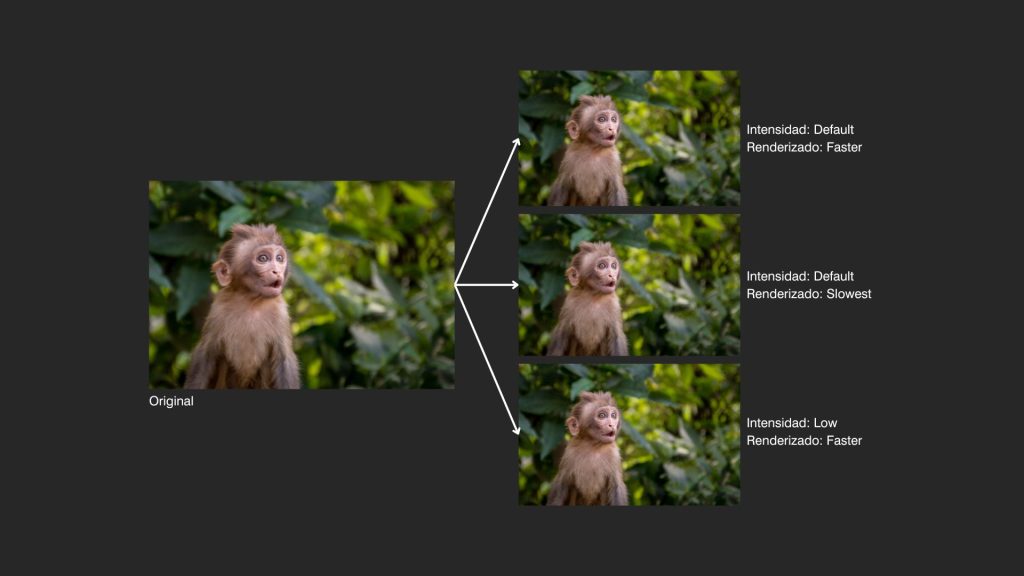

Para realizar una prueba, he subido una foto de un mono, y reconoce el sujeto inmediatamente. A continuación se ve el resultado con diferentes intensidades y calidades de renderizado:

El filtro no se aprecia al reducir el tamaño de la imagen, pero se aprecia en las vistas en detalle y reduce la calidad de la foto. Es más evidente en las zonas de bokeh, y el equipo de Glaze ya advierte de esto: funciona peor en grandes áreas de color o tintas planas.

Consideraciones

Éticas y legales

El uso de herramientas de protección proactiva contra el rascado de imágenes es controvertido. Algunos argumentan que el uso de herramientas como Glaze y Nightshade, que alteran deliberadamente las obras de arte para engañar o interferir con los sistemas de IA, podría considerarse una forma de hackeo.

Existe un debate abierto sobre si el uso de datos para entrenamiento de IAs es «fair use». Por ahora, tanto el entrenamiento de IAs como el uso de estas herramientas se encuentra en una zona gris legal y ética.

Estéticas y de calidad

Introducir ruido o cambios en el estilo de una obra puede afectar a la integridad estética del original, aunque sea de forma mínima y casi imperceptible. Como artista hay que sopesar este compromiso visual frente a los beneficios de protección.

Efectividad a largo plazo

Hay escepticismo sobre la sostenibilidad y efectividad a largo plazo de estas soluciones. A medida que la IA evoluciona, también lo hace su capacidad para detectar y adaptarse a estas alteraciones. Los desarrolladores de herramientas defensivas están buscando maneras de mantener los filtros actualizados, de forma similar a un antivirus.

Alternativas para artistas con sitio web propio

Si publicas tus obras en tu propio sitio web, tienes la posibilidad de añadir un documento de texto o meta tags con instrucciones para bots. Estas instrucciones son de cumplimiento voluntario, así que no dan garantías, pero pueden ser un primer paso y una medida ética. Si planeas usar filtros como Glaze o Nightshade sobre tus imágenes en tu web, poner advertencias servirá para afectar sólo a las IAs que las ignoren.

Más información: Dos medidas para que los bots no accedan al contenido de tu web