Nuevo: Declaración de disponibilidad para IA

En Safe Creative escuchamos las preocupaciones y deseos de los creadores, y es por eso que hemos añadido la opción de declarar si se desea impedir, permitir, o autorizar bajo acuerdo previo, el uso de las obras registradas en Safe Creative y expuestas en Creators para el entrenamiento de Inteligencias Artificiales.

- Estamos trabajando para incluir más herramientas de este tipo.

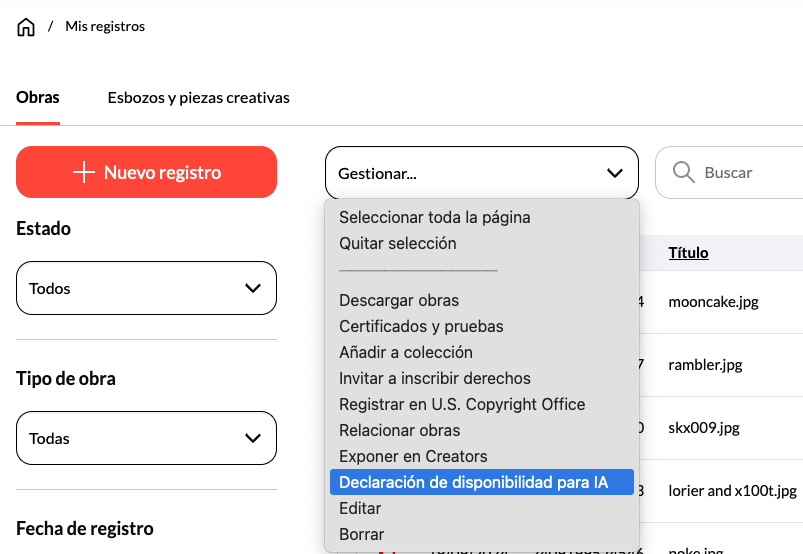

- Se puede declarar esta posibilidad, obra a obra, en varias o en todas las obras y se mostrará también en las obras que expongas en Creators.

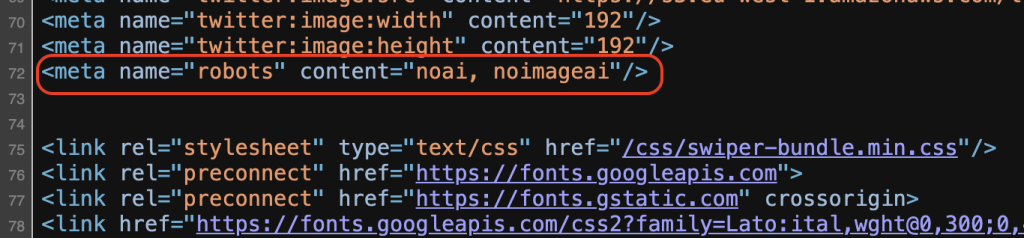

- Se añade una declaración expresa en lenguaje natural y metadatos.

El desafío de las IA generativas

La IA generativa supone enormes desafíos y ha suscitado un intenso debate que se está desarrollando en estos momentos y que durará años.

Si bien parece estar claro es que las empresas de IA generativa han llegado para quedarse, se hace necesario que se adapten a las leyes, normas de derechos de autor, así como a la expresión y decisión de los autores de las obras originales que usan para entrenar sus modelos.

Entre las propuestas que se barajan en muchos entornos, está que las empresas de IA remuneren y / o acrediten correctamente tanto los autores como las obras usadas en sus modelos. También deberán respetar el deseo expresado de aquellos autores que no quieran que sus obras se usen para el entrenamiento de las IA o de aquellos que lo puedan permitir con condiciones de remuneración o acreditación.

Es en este punto donde desde ahora ya se puede informar, en cada registro de Safe Creative, o en todos de una vez, el deseo del autor en lo relativo a que sus obras puedan ser usadas, o no, por empresas de IA generativa para entrenar sus modelos.

Las obras pueden estar en cuatro estados distintos:

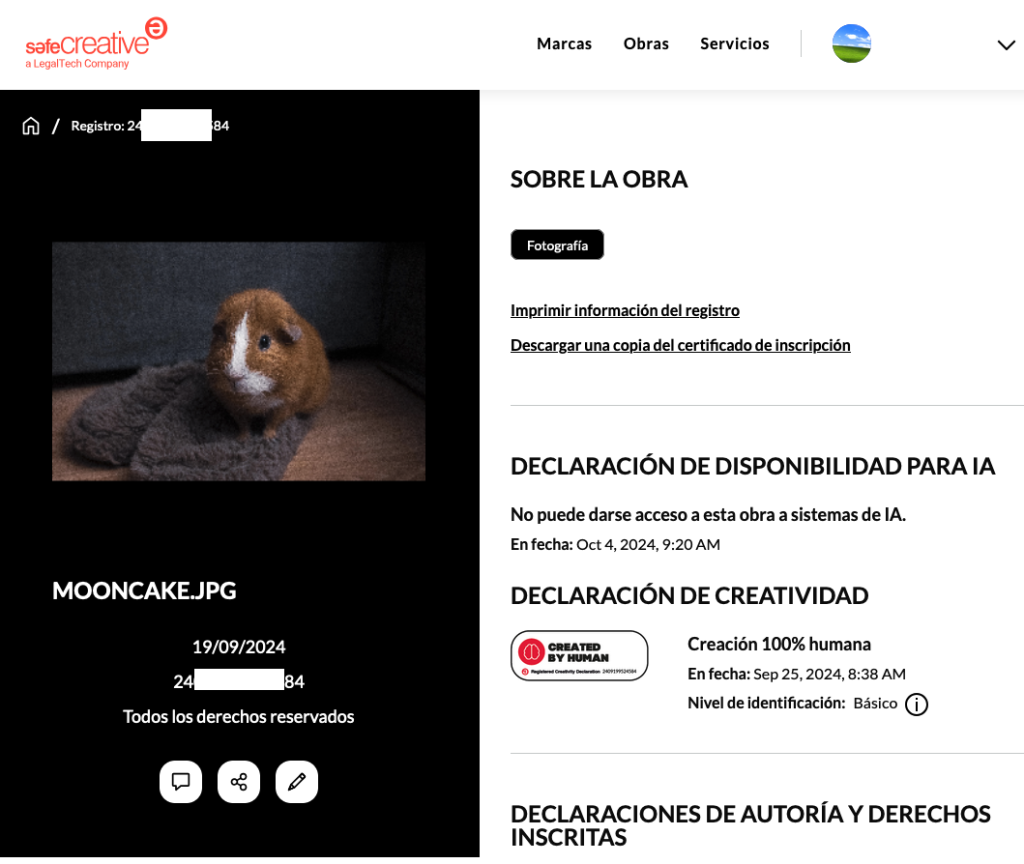

- No puede darse acceso a esta obra a sistemas de IA: No se permite el uso para entrenamiento.

- Los sistemas de IA solo podrán acceder a la obra con acuerdo previo: No se permite uso sin acuerdo previo del autor con la compañía de la IA.

- Los sistemas de IA pueden acceder a la obra: Se permite el uso de la obra para entrenar modelos de IA.

- Sin declarar nada en un sentido u otro.

Además, se puede marcar que a todas las obras en las que no se haya declarado nada, se aplique uno de los tres primeros estados descritos.

Si se eligen cualquiera de las dos opciones primeras, se incluirá el metadato propuesto por DeviantArt, para que las IA generativas no usen la obra. Además, se incluye una declaración visible en lenguaje natural. En el caso de permitir, ese metadato no se incluye, pero sí se marca el registro con una declaración visible en lenguaje natural igualmente.

En las declaraciones se incluye la fecha y hora en la que se produjo esta.

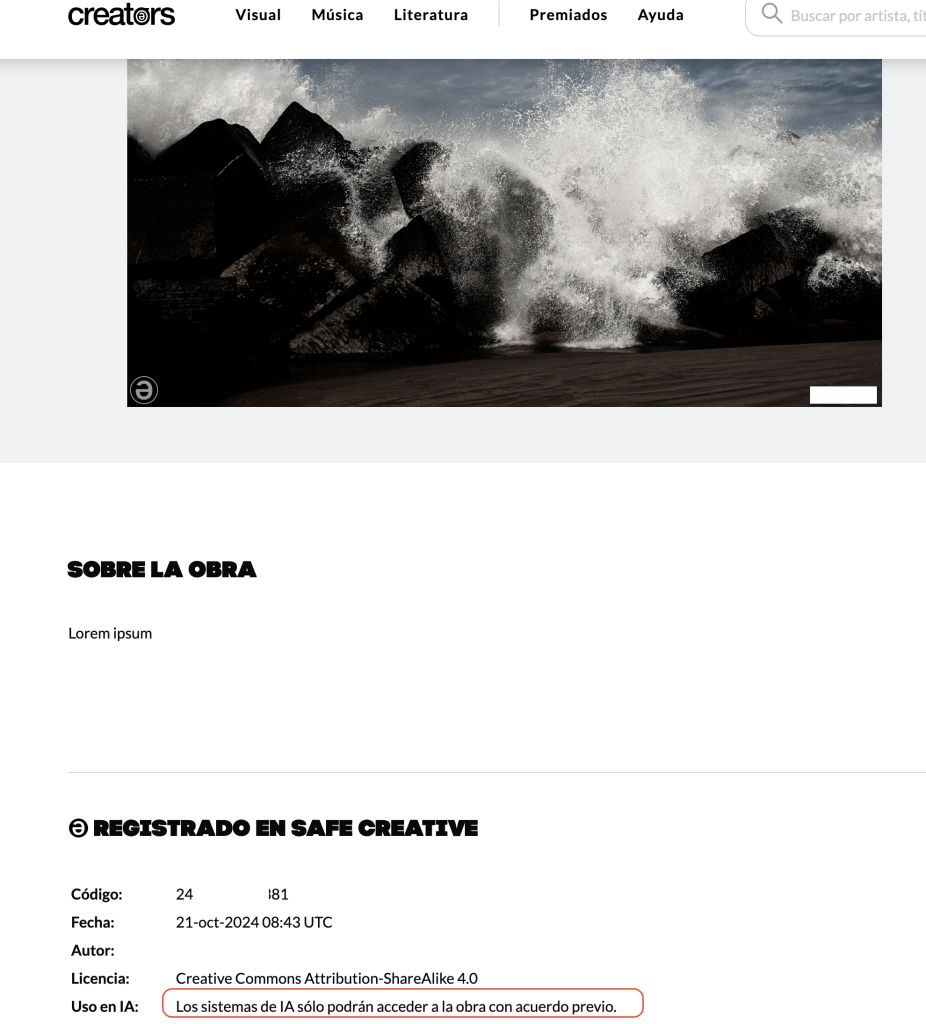

La información declarada en Safe Creative, aparece también en las obras expuestas en Creators

Hace meses que estamos trabajando en adaptar la plataforma de Creators, para la exposición de perfiles de creadores y sus mejores obras, según los comentarios recibidos. Es por eso que hemos añadido que la información expresada en las obras registradas en Safe Creative, también sea visible en Creators. De esta manera, Creators añade una capa más de seguridad para exponer las obras según el deseo de los artistas en función de sus preferencias en lo relativo a las IA generativas.

Habrá más herramientas en el futuro

Se trata de un paso importante y necesario en el camino de ser transparentes y que se escuche a los creadores de obras originales.

Vamos a seguir trabajando en mejorar este y otros sistemas, para complementar las herramientas que ya ofrece Safe Creative y que llevan ayudando a creadores de todo el mundo desde 2007.

Opinión de Luciano F. Amaya dirigida a Mario Pena, Safe Creative

Sobre la nueva función de declaración de disponibilidad para IA

Mario, he leído con atención tu comunicado. Te hablo con la sinceridad del creador que soy y con el respeto que merece quien, como tú, defiende herramientas que protegen nuestro trabajo.

Esta nueva funcionalidad me parece un paso necesario, pero tardío. El daño ya está hecho para muchos: obras usadas sin permiso, identidades diluidas entre datasets, y artistas que ven cómo su estilo es replicado sin crédito, sin diálogo, sin ni siquiera un «gracias». Aplaudo que Safe Creative incorpore estas opciones de declarar explícitamente si se permite o no el uso de nuestras obras por sistemas de IA. Es un mínimo ético que ya debió existir desde que empezaron a jugar con nuestra creatividad como quien revuelve cartas ajenas.

Pero no basta con poner un botón o un metadato. Esto debe ir de la mano con acciones legales concretas, transparencia real y presión institucional. Porque las grandes tecnológicas no respetan buenas intenciones, respetan contratos, acuerdos y denuncias. Si entrenaron sus modelos sin preguntar, dudo que se detengan por un «preferiría que no».

Yo, como autor, me reservo el derecho de negociar, de ser reconocido y, si corresponde, de ser justamente remunerado. No me opongo al avance de la inteligencia artificial —la uso, la estudio, incluso la enseño—, pero no acepto que crezca a costa de exprimir el alma de quienes creamos desde la nada.

Así que sí, celebro este avance. Pero exijo más. Porque si la IA vino para quedarse, que también aprenda a respetar.

Luciano Francisco Amaya Gutiérrez

Creador digital y defensor del uso ético de la tecnología

@lucianocminteligencia

Post-data Desarrolle mi propio modelo, asistido por la IA, al Final tanta controversia, por el uso de la misma, que por mucho que hable, no es mas que la sustitución, de la manera como interactuamos con un ordenador, leí el reglamento que quieren implementar, donde se exige reconocimiento al desarrollador del software, como parte de la autoría, de la obra, o creación por medio de la IA, yo me pregunto: También lo van a responsabilizar por el daño que haga una persona non grata, por medio del Uso de la Inteligencia Artificial, No es otra cosa mas, que un software, que responde a la estructura de un buen o mal prompt., no deja de ser una herramienta, en este caso intangible, como lo puede ser un tractor, eso es lo mismo que se le exija al Agricultor, compartir una porción del beneficio obtenido, después de su ardua faena, con los distinto fabricantes, de las herramientas e implementos agrícolas, por qué gracias a ella se le facilitó el trabajo.

Gracias Luciano por el comentario. Es importante señalar que si bien hemos implementado esto recientemente, no es lo único que estamos haciendo. También estamos en contacto con varias instituciones y grupo de interés para ofrecer nuestra perspectiva a los empeños que se están haciendo para instar un uso ético de la IA. Como decimos, existen muchos grupos de presión que están actualmente trabajando e influyendo, igualmente, tanto en los aspectos de reconocimiento, compensación y transparencia, como en todo lo relativo a la regulación de responsabilidades y el régimen sancionador por el uso no adecuado de estas importantes y potentes herramientas. Lo que suele pasar en estos casos es que mucho del trabajo que se está haciendo no está siendo muy publicitado. Algunas iniciativas, como la reciente reunión del grupo de C2PA CAI, en la que participamos, es una muestra puntual de uno de los muchos esfuerzos y trabajos que se están realizando. También existen múltiples demandas que se están dando en varios continentes, así como negociaciones y acuerdos de diversa índole.